Que é un ficheiro Robots.txt? Todo o que necesitas para escribir, enviar e volver a rastrexar un ficheiro Robots para SEO

Escribimos un artigo completo sobre como os buscadores atopan, rastrexan e indexan os seus sitios web. Un paso fundamental nese proceso é o robots.txt ficheiro, a porta de entrada para que un motor de busca rastrexe o teu sitio. Comprender como construír un ficheiro robots.txt correctamente é esencial na optimización do motor de busca (SEO).

Esta ferramenta sinxela pero poderosa axuda aos administradores web a controlar como interactúan os motores de busca cos seus sitios web. Comprender e utilizar eficazmente un ficheiro robots.txt é esencial para garantir a indexación eficiente dun sitio web e unha visibilidade óptima nos resultados do buscador.

Que é un ficheiro Robots.txt?

Un ficheiro robots.txt é un ficheiro de texto situado no directorio raíz dun sitio web. O seu obxectivo principal é guiar aos rastrexadores dos motores de busca sobre cales partes do sitio deben ou non rastrexarse e indexarse. O ficheiro usa o protocolo de exclusión de robots (REP), un estándar que os sitios web usan para comunicarse cos rastreadores web e outros robots web.

O REP non é un estándar oficial de Internet, pero é amplamente aceptado e apoiado polos principais motores de busca. O máis próximo a un estándar aceptado é a documentación dos principais buscadores como Google, Bing e Yandex. Para máis información, visitando Especificacións de Google Robots.txt se recomenda.

Por que Robots.txt é crítico para o SEO?

- Rastrexo controlado: Robots.txt permite aos propietarios de sitios web evitar que os buscadores accedan a seccións específicas do seu sitio. Isto é especialmente útil para excluír contido duplicado, áreas privadas ou seccións con información confidencial.

- Orzamento de rastrexo optimizado: Os motores de busca asignan un orzamento de rastrexo para cada sitio web, o número de páxinas que un robot de buscador rastrexará nun sitio. Ao non permitir seccións irrelevantes ou menos importantes, robots.txt axuda a optimizar este orzamento de rastrexo, garantindo que se rastrexen e indexen as páxinas máis significativas.

- Tempo de carga do sitio web mellorado: Ao evitar que os bots accedan a recursos sen importancia, robots.txt pode reducir a carga do servidor, mellorando potencialmente o tempo de carga do sitio, un factor crítico no SEO.

- Prevención da indexación de páxinas non públicas: Axuda a evitar que as áreas non públicas (como os sitios de proba ou as áreas de desenvolvemento) sexan indexadas e aparezan nos resultados da busca.

Comandos esenciais de Robots.txt e os seus usos

- Permitir: Esta directiva úsase para especificar a que páxinas ou seccións do sitio deben acceder os rastrexadores. Por exemplo, se un sitio web ten unha sección especialmente relevante para o SEO, o comando "Permitir" pode garantir que se rastrexa.

Allow: /public/- Non permitir: Ao contrario de "Permitir", este comando indica aos robots de busca que non rastrexen determinadas partes do sitio web. Isto é útil para páxinas sen valor de SEO, como páxinas de inicio de sesión ou ficheiros de script.

Disallow: /private/- Comodíns: Os comodíns úsanse para a correspondencia de patróns. O asterisco (*) representa calquera secuencia de caracteres e o signo de dólar ($) indica o final dun URL. Son útiles para especificar unha ampla gama de URL.

Disallow: /*.pdf$- Mapas do sitio: A inclusión dunha localización do mapa do sitio en robots.txt axuda aos motores de busca a atopar e rastrexar todas as páxinas importantes dun sitio. Isto é crucial para o SEO xa que axuda á indexación máis rápida e completa dun sitio.

Sitemap: https://martech.zone/sitemap_index.xmlComandos adicionais de Robots.txt e os seus usos

- Axente de usuario: Especifique a que explorador se aplica a regra. 'User-agent: *' aplica a regra a todos os rastrexadores. Exemplo:

User-agent: Googlebot- Noindex: Aínda que non forma parte do protocolo estándar robots.txt, algúns motores de busca entenden a Sen índice directiva en robots.txt como instrución para non indexar o URL especificado.

Noindex: /non-public-page/- Retraso de rastrexo: Este comando pídelles aos rastrexadores que agarden un tempo específico entre as visitas ao teu servidor, útil para sitios con problemas de carga do servidor.

Crawl-delay: 10Como probar o teu ficheiro Robots.txt

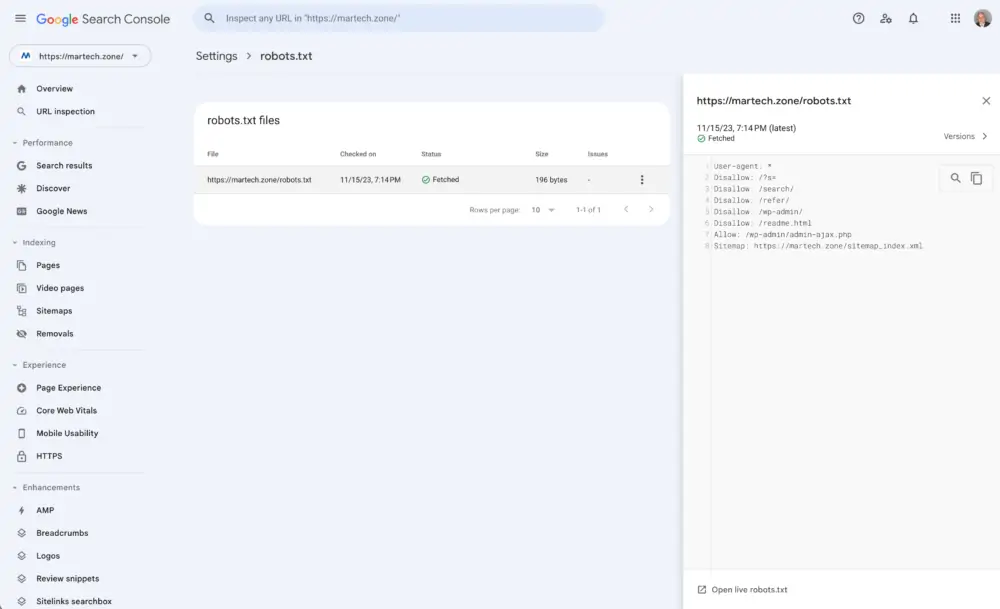

Aínda que está enterrado Consola de busca de Google, a consola de busca ofrece un probador de ficheiros robots.txt.

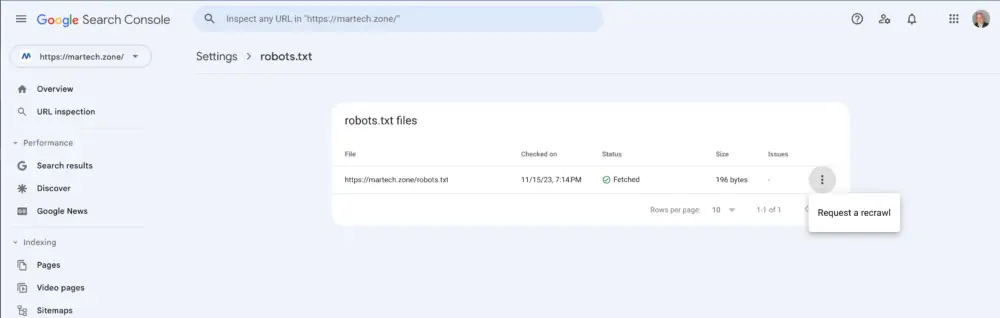

Tamén podes volver enviar o teu ficheiro Robots.txt facendo clic nos tres puntos da dereita e seleccionando Solicitar unha nova exploración.

Proba ou volve enviar o teu ficheiro Robots.txt

Pódese usar o ficheiro Robots.txt para controlar os bots de IA?

O ficheiro robots.txt pódese usar para definir se AI Os bots, incluídos os rastrexadores web e outros robots automatizados, poden rastrexar ou utilizar o contido do teu sitio. O ficheiro guía a estes bots, indicando a que partes do sitio web se lles permite ou non acceder. A eficacia de robots.txt para controlar o comportamento dos bots de IA depende de varios factores:

- Adhesión ao Protocolo: Os rastrexadores de buscadores máis reputados e moitos outros bots de IA respectan as regras establecidas

robots.txt. Non obstante, é importante ter en conta que o ficheiro é máis unha solicitude que unha restrición aplicable. Os bots poden ignorar estas solicitudes, especialmente as operadas por entidades menos escrupulosas. - Especificidade das instrucións: Podes especificar diferentes instrucións para diferentes bots. Por exemplo, podes permitir que bots de IA específicos rastrexen o teu sitio mentres non permites outros. Isto faise usando o

User-agentdirectiva norobots.txtexemplo de ficheiro anterior. Por exemplo,User-agent: Googlebotespecificaría instrucións para o rastrexador de Google, mentres queUser-agent: *aplicaríase a todos os bots. - Limitacións: Mentres

robots.txtpode evitar que os bots rastrexen contido especificado; non lles oculta o contido se xa o coñecen URL. Ademais, non ofrece ningún medio para restrinxir o uso do contido unha vez que foi rastrexado. Se se require protección de contido ou restricións de uso específicas, poden ser necesarios outros métodos como a protección por contrasinal ou mecanismos de control de acceso máis sofisticados. - Tipos de bots: Non todos os bots de IA están relacionados cos motores de busca. Utilízanse varios bots para diferentes propósitos (por exemplo, agregación de datos, análise, raspado de contido). O ficheiro robots.txt tamén se pode usar para xestionar o acceso a estes diferentes tipos de bots, sempre que se adhiran ao REP.

o robots.txt O ficheiro pode ser unha ferramenta eficaz para sinalar as súas preferencias sobre o rastrexo e a utilización do contido do sitio por parte dos bots de IA. Non obstante, as súas capacidades limítanse a proporcionar pautas en lugar de facer cumprir un estrito control de acceso, e a súa eficacia depende do cumprimento dos robots do Protocolo de exclusión de robots.

O ficheiro robots.txt é unha ferramenta pequena pero poderosa no arsenal de SEO. Pode influír significativamente na visibilidade dun sitio web e no rendemento do motor de busca cando se usa correctamente. Ao controlar que partes dun sitio se rastrexan e indexan, os administradores web poden asegurarse de que o seu contido máis valioso se destaque, mellorando os seus esforzos de SEO e o rendemento do sitio web.